Představte si video, kde známý politik vyhlašuje něco, co by ve skutečnosti nikdy neřekl. Nebo bankovní poradce, který vám na videohovoru odsouhlasí převod několika milionů, a pak se ukáže, že to vůbec nebyl on. Vítejte ve světě deepfaků, sofistikovaných digitálních podvrhů, které jsou natolik přesvědčivé, že klamou i realitu samotnou.

Co znamená deepfake

Termín „deepfake“ vznikl spojením slov „deep learning“ (hluboké učení) a „fake“ (podvrh). A to přesně vystihuje podstatu věci: umělá inteligence, konkrétně neuronové sítě, se učí napodobit mimiku, hlas nebo gesta reálných lidí s téměř děsivou přesností. Co kdysi působilo jako sci-fi, je dnes realitou a při dnešní dostupnosti AI reálnou hrozbou, která se schovává uvnitř našich obrazovek.

Deepfaky se už dávno nepoužívají jen pro zábavu nebo meme videa. Jsou nástrojem kreativního průmyslu, ale čím dál častěji i zbraní pro manipulaci, podvody a informační války. S tím, jak jsou moderní AI modely stále dostupnější, se dramaticky snižuje laťka vstupu. Hlas známé osoby dnes lze napodobit pomocí AI během chvíle z pár minutové nahrávky. Vizuální deepfake je možné vytvořit online, když víte jak správně promptovat a obejít pravidla. Tvorba digitálních podvrhů už není výsadou programátorů nebo hackerů, a právě proto je čas porozumět tomu, co jsou, jak fungují, kde se objevují a jak je rozpoznat dřív, než se naše vnímání reality zcela nenávratně promění.

Jak deepfake tvoří dokonalou iluzi

Deepfaky nejsou žádným nadpřirozeným technickým zázrakem, ale fungují na principu, dnes již velmi rozšířené generativní AI, která je trénovaná na lidské tváře, hlasy a pohyby. V jádru celého procesu stojí strojové učení a tzv. generativní neuronové sítě, konkrétně GANy (Generative Adversarial Networks). Ty fungují jako dvojice soupeřících algoritmů, přičemž jeden se snaží vytvořit co nejrealističtější falešný obsah a druhý ho naopak odhaluje. Společně se postupně zlepšují, s každým tréninkem se výstup stává přesvědčivější, dokonalejší a téměř nerozeznatelný od reality.

Tvorba deepfaku začíná sběrem dat – fotografií, videí nebo zvukových záznamů osoby, kterou chce napodobit. Čím víc dat, tím přesnější výsledek. AI pak analyzuje mimiku, gesta, intonaci i mikrovýrazy a začne je digitálně modelovat. Dnes už dokáže nejen „přilepit“ obličej na cizí tělo, ale i věrohodně napodobit hlas nebo synchronizovat rty podle nově nahraného projevu.

Výsledný deepfake může mít mnoho podob: video, kde někdo říká něco, co nikdy neřekl, audiozáznam s podvrženým hlasem, nebo dokonce digitální avatar, který vystupuje v reálném čase na schůzce. A zatímco dřív šlo o technologii dostupnou jen expertům, dnes si deepfake video vytvoří i laik s běžným počítačem.

Typy deepfaků

Většina lidí si při slově deepfake představí falešné, většinou inkriminující video veřejně známé osoby. Ale tato technologie má mnohem širší paletu podob. Nejznámější jsou video deepfaky, které manipulují mimiku a řeč obličeje tak, aby někdo vypadal, že říká něco jiného. Rychle se ale rozvíjejí i audio deepfaky, které pomocí krátké nahrávky dokážou napodobit hlas konkrétní osoby, čím delší nahrávka, tím lépe umělá inteligence napodobuje hlas konkrétní osoby. Získat rozsáhlý audio materiál je u veřejně vystupujících osob velice snadné.

V praxi už se běžně setkáváme také s avatar deepfaky, kdy digitální klon člověka vystupuje na videohovoru v reálném čase, nebo s obrazovými deepfaky, které vytvářejí zcela věrohodné statické portréty. A pak jsou tu ještě syntetické obličeje, což jsou generované osoby, které nikdy neexistovaly, ale vypadají zcela reálně a často se používají ve falešných profilech nebo reklamách.

Známé případy, kdy deepfake pokořil realitu

Případů kdy se společnost nechala obelstit umělou inteligencí je bohužel opravdu mnoho. Některé jsou spíše úsměvné, ale většinou je deepfake využíván k tomu, aby manipuloval, okrádal a poškozoval, většinou politické osobnosti.

Například v roce 2024 proběhl ve Spojeném království sofistikovaný deepfake útok, při kterém napodobení hlasu generálního ředitele banky vedlo ke ztrátě milionů liber. Stačilo, aby zaměstnanci během videohovoru věřili, že mluví s ředitelem a zadali platbu podle falešných instrukcí. Tón hlasu, rytmus i způsob vyjadřování byly dokonale zkopírovány.

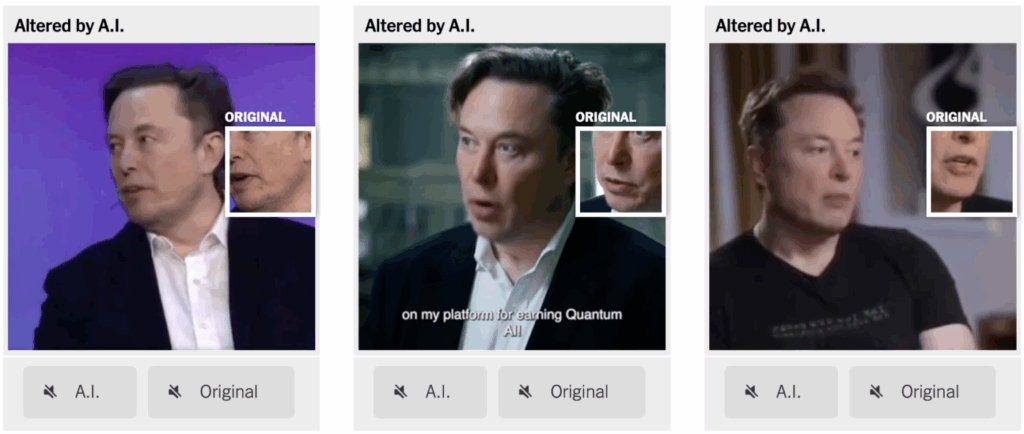

Ve známém incidentu z období ruské invaze na Ukrajinu se na sociálních sítích objevilo deepfake audiovizuální záznam prezidenta Zelenského, ve kterém údajně vyzývá ke kapitulaci. Video bylo vytvořeno pomocí deepfake technologie a mělo za cíl oslabit důvěru veřejnosti a vojáků. Podobně se šířily i deepfake reklamy s Elonem Muskem, který v nich doporučoval falešné investice do kryptoměn a stovky lidí tak přišly o nemalé částky.

Ukázka rozdílu mezi deepfake a originálem.

Ještě dál zašel případ z Hongkongu, kde byl falešný avatar použit jako zaměstnanec na Zoom hovoru. Během schůzky si vyžádal převod peněz a firma přišla o více než 20 milionů dolarů.

V roce 2024 krátce před americkými volbami kolovala audio nahrávka s hlasem prezidenta Bidena, ve které údajně odrazuje Afroameričany od účasti ve volbách. Nahrávka byla zcela syntetická, ale profesionálně zpracovaná a mohla mít přímý dopad na rozhodování voličů.

Ovšem ne všechny deepafaky jsou tvořeny se zlým úmyslem, některé mají za cíl pobavit nebo na něco satiricky poukázat. Třeba ikonická fotografie papeže Františka ve sněhobílé péřové bundě luxusní designové značky Balenciaga, která zaplavila internet. Ačkoli byla od začátku falešná, spousta lidí si myslela, že je reálná. Tento případ je vtipná, ale zároveň varující ukázka toho, jak je snadné vytvořit vizuální iluzi.

Deepfake obrázek papeže Františka.

Detaily prozrazující, že se jedná o deepfake obrázek.

Na sociálních sítích se objevují i bizarní kombinace, jako Donald Trump v historických uniformách nebo anglický fotbalový trenér Gareth Southgate „zachycený“ při vulgárním výlevu. Jde o satirické deepfaky, které mají pobavit a využívají technologii spíš jako komediální nástroj než jako zbraň. Ale i tyto odlehčené případy nám připomínají, že obraz už nemusí být důkazem a v této době je věřit vlastním očím a uším čím dál tím obtížnější, jelikož i to nejpřesvědčivější, co vidíme nebo slyšíme, může být překroucená digitálně zkonstruovaná realita.

Deepfake paparazzi fotka ukazující zatčení Donalda Trumpa.

Všechny tyto poškozující případy jsou dávno za hranicí etiky, nicméně kolem umělé inteligence se vyskytuje mnoho otázek týkajících se etičnosti a to nejen u DeepFaku. Tématu etiky se věnuje náš článek Etika umělé inteligence.

Jak poznat deepfake a nenaletět

Přestože je dnešní technologie tak pokročilá, že dokáže téměř dokonale simulovat realitu, tak existují určité signály, které mohou pomoci odhalit, že se díváme na něco uměle vytvořeného.

U videí je dobré si všímat drobných nesrovnalostí, třeba mimice, která neodpovídá obsahu řeči, neobvyklé mrkání nebo nepravidelnosti v pohybu rtů. Častým vodítkem bývá i podivné osvětlení, stíny, které nedávají smysl, nebo rozmazané oblasti kolem očí a úst. U deepfake audia může být varovným signálem nepřirozená intonace, chybějící emoce nebo „sterilní“ zabarvení hlasu.

Dalším varovným signálem může být samotný kontext. Pokud se objevuje obsah, který působí šokujícím nebo virálním dojmem a není dostupný z více ověřených zdrojů, je dobré zpozornět. Zpětné vyhledávání obrázků, kontrola původu videa nebo ověření přes fact-checkingové platformy (např. Snopes, Bellingcat nebo Google Lens) mohou odhalit, zda nejde o podvrh.

Ačkoli se technologie rychle zlepšuje, stále je pro laika možné odhalit alespoň některé známky manipulace, klíčem je kritické myšlení a schopnost zpochybnit i to, co vypadá „na první pohled jasně“.

Aktualizováno: 2. 7. 2025

Zdroje:

What is Deepfake Technology? | Definition from TechTarget [online]. [cit. 02. 07. 2025]. Dostupné z: https://www.techtarget.com/whatis/definition/deepfake

Top 10 Terrifying Deepfake Examples [online]. [cit. 02. 07. 2025]. Dostupné z: https://arya.ai/blog/top-deepfake-incidents

Top 5 Cases of AI Deepfake Fraud From 2024 Exposed | Blog | Incode [online]. [cit. 02. 07. 2025]. Dostupné z: https://incode.com/blog/top-5-cases-of-ai-deepfake-fraud-from-2024-exposed/