Technologie umělé inteligence se nezadržitelně zdokonalují, aktuálně je na vzestupu generativní AI. Spolu s tím se ale ve společnosti zvyšuje obava o bezpečí vlastních dat a hlavně strach ze zneužití vlastní osoby nebo děl. Společnosti, které využívají generativní umělou inteligenci se dostávají pod drobnohled, protože jejich užívání autorsky chráněných uměleckých děl jako školícího materiálu je eticky velmi sporné. Stávající zákony často nestačí na regulaci nových technologií, což vytváří prostor pro zneužití.

Evropská unie se proto rozhodla převzít vedoucí roli v oblasti AI regulace a jako první vytvořit právní rámec, který by zajistil bezpečný a etický rozvoj těchto technologií. Jeho účelem je regulovat AI, nebo se alespoň pokusit regulovat nástroje s umělou inteligencí, které by mohly napáchat více škody než užitku. Tento zákon má v plnou platnost vstoupit v srpnu 2026 (kdy už budeme ovšem zase o kus dál). Pro Českou republiku jako členskou zemi EU má AI Act zásadní význam.

Koho se bude zákon dotýkat?

- Poskytovatelé AI systémů nesou největší odpovědnost podle nového zákona. Jedná se o firmy a organizace, které vyvíjejí, vyrábějí nebo významně upravují AI systémy. Do této kategorie spadají jak velké technologické korporace jako Google, Microsoft nebo Meta, tak i menší české startupy vyvíjející AI aplikace. Poskytovatelé musí zajistit, aby jejich AI systémy splňovaly všechny požadavky zákona ještě před uvedením na trh, včetně dokumentace, testování a případné certifikace.

- Uživatelé AI systémů představují druhou klíčovou skupinu. Jsou to firmy, organizace a instituce, které nasazují AI systémy ve svých procesech, i když je samy nevyvinuly. Patří sem nemocnice s AI diagnostikou, maloobchodní řetězce s doporučovacími systémy nebo výrobní podniky s prediktivní údržbou. Uživatelé musí zajistit správné používání AI systémů podle pokynů poskytovatelů a dodržovat požadavky na lidský dohled.

- Orgány veřejné moci čelí specifickým požadavkům, protože jejich rozhodnutí mají přímý dopad na práva občanů. Ministerstva, krajské úřady, obce, soudy, policie i další státní instituce budou muset pečlivě dokumentovat použití AI a zajistit transparentnost automatizovaných rozhodnutí. Zvláštní pozornost bude věnována AI systémům používaným v justici, sociálních službách nebo při kontrole dodržování zákonů.

- Notifikované subjekty představují novou kategorii institucí pověřených certifikací AI systémů vysokého rizika. Tyto nezávislé organizace budou hodnotit, zda AI systémy splňují požadavky zákona, a vydávat certifikáty potřebné pro uvedení na trh.

Z geografického hlediska se zákon vztahuje nejen na subjekty se sídlem v EU, ale i na zahraniční firmy, jejichž AI systémy se používají v Evropě. Pokud americká firma provozuje chatbota pro evropské zákazníky nebo čínský výrobce dodává AI komponenty do evropských továren, musí dodržovat AI Act. Klíčové je místo použití AI systému, nikoli místo jeho vývoje.

Zákon obsahuje pouze omezené výjimky. Nevztahuje se na AI systémy používané výhradně pro vojenské účely, na výzkumné a vývojové projekty před komerčním nasazením a na AI používanou čistě pro osobní neobchodní účely. Prakticky to znamená, že pokud si někdo nainstaluje AI aplikaci pouze pro vlastní zábavu, zákon se na něj nevztahuje, ale jakmile stejnou aplikaci použije ve firmě, stává se uživatelem podle AI Act. Takže se nemusíte bát si stáhnout OCTODEEP 🙂

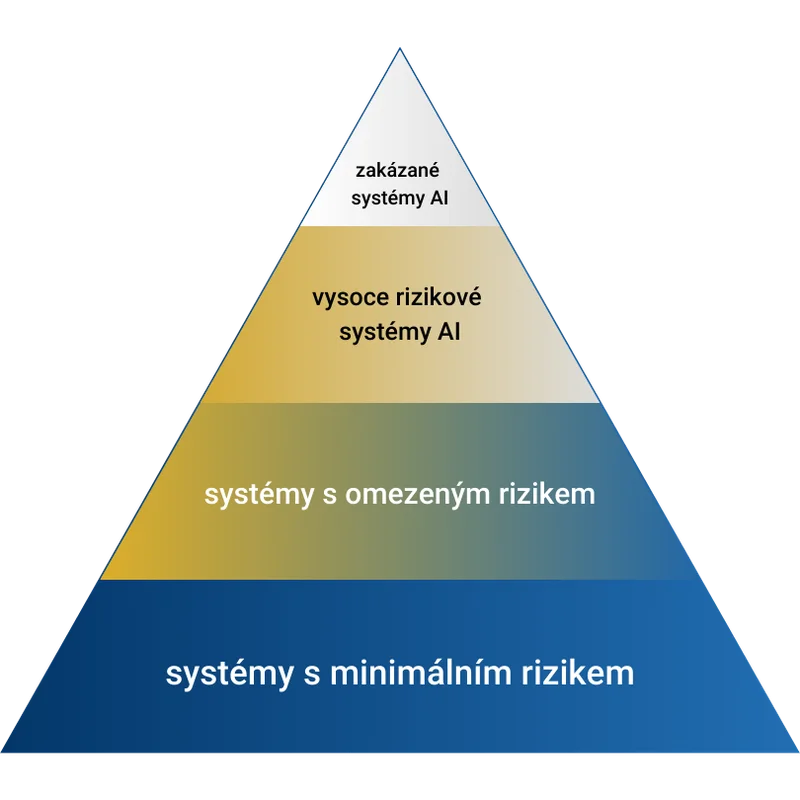

4 rizikové kategorie

Akt o umělé inteligenci definuje čtyři úrovně rizika u AI:

Nepřijatelné riziko (zakázané AI systémy), například:

- necílené stahování snímků obličeje z internetu nebo ze záznamů uzavřených kamerových systémů (CCTV),

- rozpoznávání emocí na pracovištích a ve vzdělávacích institucích

- biometrická kategorizace s cílem získat citlivé údaje, jako je rasa, věk, pohlaví, sexuální orientace či náboženské vyznání,

- biometrická identifikace na dálku v reálném čase pro účely vymáhání práva na veřejně přístupných místech

- podprahová manipulace a klamání založené na umělé inteligenci

- hodnocení sociálního kreditu (jako v Číně)

Vysoké riziko (přísně kontrolované AI systémy):

- systémy umožňující biometrickou identifikaci

- kritická infrastruktura (např. řízení dopravy)

- vzdělávání (např. bodování zkoušek), které může určovat přístup ke vzdělání či průběhu profesního života

- bezpečnostní komponenty výrobků (např. aplikace AI v chirurgii podporované roboty)

- zaměstnávání, řízení pracovníků (např. software pro třídění životopisů pro příjímací řízení)

- řízení migrace, azylu a ochrany hranic (např. automatizované posuzování žádostí o víza)

- výkon spravedlnosti a demokratických procesů (např. řešení založená na AI pro vyhledávání soudních rozhodnutí)

Tyto systémy budou mít povinnost projít složitým procesem takzvaného ověřování shody. Během něj se ukáže, zda a jak který systém splňuje požadavky na transparentnost, lidský dohled, kybernetickou bezpečnost, kvalitu tréninkových dat atd.

Omezené riziko (transparentnost)

To se týká rizik spojených s potřebou transparentnosti, pokud jde o používání umělé inteligence. Akt o umělé inteligenci zavádí zvláštní povinnosti týkající se zveřejňování informací s cílem zajistit, aby byli lidé informováni, je-li to nezbytné k zachování důvěry. Například při používání systémů umělé inteligence, jako jsou chatboti, by si lidé měli být vědomi toho, že komunikují se strojem, aby mohli učinit informované rozhodnutí.

Poskytovatelé generativní umělé inteligence musí navíc zajistit, aby byl obsah vytvořený umělou inteligencí identifikovatelný. Kromě toho by měl být určitý obsah vytvořený umělou inteligencí jasně a viditelně označen, konkrétně deep fakes a text zveřejňovaný za účelem informování veřejnosti o záležitostech veřejného zájmu.

Minimální riziko (téměř bez regulace)

Všechny ostatní systémy umělé inteligence lze uvádět na trh a používat v souladu se stávajícími právními předpisy bez dalších právních povinností. V současné době do této kategorie spadá většina systémů, které se používají nebo budou používat v EU.

Dopady na české prostředí

Technologické společnosti

České AI startupy a scale-upy čekají významné změny. Nové compliance náklady budou představovat nutnost investic do právního poradenství, dokumentace a certifikace, což může pro menší firmy představovat značnou zátěž. Na druhou stranu se však otevírají nové příležitosti. Compliance s AI Act může být konkurenční výhodou, kdy firmy získají certifikaci „AI Made in EU“ jako důvěryhodnou značku. Tato certifikace může usnadnit přístup k financování, protože investoři stále častěji požadují compliance s AI Act jako podmínku pro poskytnutí investice. Harmonizovaná regulace také otevírá exportní příležitosti a usnadňuje vstup na evropské trhy.

Tradiční podniky využívající AI

Finanční sektor čeká zásadní transformace. Banky jako Česká spořitelna, ČSOB a Komerční banka budou muset přehodnotit své AI systémy pro úvěrové skóringy, které spadají do kategorie vysokého rizika. Dokumentace AI chatbotů a doporučovacích systémů bude vyžadovat nové procesy pro testování zaujatosti a auditování algoritmů. Pojišťovny včetně Kooperativy, Generali a Allianz budou muset zajistit compliance pro AI v oceňování rizik a vyřizování škod, přičemž transparentnost automatizovaného rozhodování o pojistných událostech se stane klíčovým požadavkem.

V oblasti maloobchodu a e-commerce budou firmy jako Alza, Mall.cz a Rohlík muset dokumentovat své doporučovací algoritmy a zajistit transparentnost personalizovaného cenového určování. Compliance bude nutné také pro AI systémy v logistice a skladování. Průmyslové podniky jako Škoda Auto a Barum Continental využívají AI v prediktivní údržbě, která spadá do kategorie minimálního rizika, ale systémy kontroly kvality s AI mohou představovat potenciálně vysoké riziko.

Telekomunikační operátoři O2, T-Mobile a Vodafone budou muset zajistit compliance pro AI systémy správy sítí a optimalizace provozu, chatboty a virtuální asistenty, stejně jako systémy pro detekci podvodů.

Státní správa a samospráva

Ministerstva a ústřední orgány budou muset přehodnotit své AI systémy podle nových pravidel. Ministerstvo vnitra se zaměří na AI v biometrii a rozpoznávání tváří na hranicích, Ministerstvo financí na AI v daňové správě a detekci daňových úniků, zatímco Ministerstvo práce bude řešit AI v systémech sociálních dávek. Česká pošta využívá AI v logistice a třídění zásilek, což bude vyžadovat odpovídající dokumentaci a compliance.

Krajské a obecní úřady čelí výzvám v oblasti smart city projektů, kde se AI využívá v dopravě, energetice a bezpečnosti. Specifické výzvy zahrnují nutnost specifikovat AI compliance požadavky ve veřejných zakázkách, zajistit transparentnost a informovat občany o použití AI, stejně jako jasně definovat odpovědnost za AI rozhodnutí.

Zdravotnictví, vzdělávání, justice

Velké změny se budou dít i ve zdravotnickém sektoru. Nemocnice jako VFN, FN Motol a IKEM budou muset certifikovat AI diagnostiku jako systémy vysokého rizika, dokumentovat a validovat AI asistenty pro lékaře a zajistit přísné bezpečnostní standardy pro robotickou chirurgii s AI. Pojišťovny, zejména VZP, budou muset přizpůsobit AI systémy pro detekci podvodů ve zdravotnictví a automatizované schvalování léčby.

Ve vzdělávání budou vysoké školy jako ČVUT, UK a VUT implementovat compliance pro AI tutoring systémy, automatizované hodnocení prací a personalizované vzdělávací platformy. Základní a střední školy budou řešit AI asistenty pro učitele a systémy pro detekci plagiátorství.

Justiční systém bude muset pečlivě rozlišovat mezi povoleným a zakázaným použitím AI. Soudy mohou využívat AI pro analýzu precedentů jako systémy omezeného rizika, ale prediktivní systémy pro recidivu spadají do kategorie vysokého rizika a jsou zakázány. Státní zastupitelství může využívat AI pro analýzu důkazů a systémy pro prioritizaci případů.

Nová práva pro občany

AI Act přináší občanům čtyři základní kategorie práv. Právo na informace o AI zahrnuje možnost vědět, kdy s nimi AI systém interaguje, získat informace o logice automatizovaného rozhodování a kontaktní údaje na odpovědnou osobu. Právo na lidský přezkum umožňuje požádat o přehodnocení AI rozhodnutí člověkem, získat vysvětlení AI rozhodnutí a podat námitku proti automatizovanému rozhodnutí.

V jednom z nedávných článků jsme se věnovali riziku toho, že by AI mohla diskriminovat. I o tento aspekt by se měl postarat AI Act, jehož součástí bude i právo na ochranu před diskriminací, které zajišťuje ochranu před zaujatostí v AI systémech, rovné zacházení bez ohledu na pohlaví, věk nebo etnický původ a možnost nahlásit diskriminační chování AI. Právo na bezpečnost poskytuje ochranu před nebezpečnými AI systémy, právo na informace o bezpečnostních opatřeních a možnost nahlásit bezpečnostní incidenty.

Transparentnost AI rozhodování

Povinná transparentnost se bude vztahovat na několik klíčových oblastí. Ve finančních službách budou muset instituce jasně vysvětlit, proč byl úvěr zamítnut, poskytnout informace o faktorech ovlivňujících úrokovou sazbu a zajistit transparentní pojistné kalkulace. V oblasti zaměstnání budou zaměstnavatelé muset informovat o použití AI při výběru kandidátů, vysvětlit hodnocení výkonu zaměstnanců a zajistit transparentnost AI v HR procesech.

Zdravotnictví bude muset poskytovat vysvětlení AI diagnostických doporučení, informace o spolehlivosti AI systémů a možnost získat druhý názor. Veřejné služby budou muset zajistit transparentnost AI v sociálních dávkách, vysvětlit automatizovaná rozhodnutí úřadů a stanovit jasné postupy pro odvolání.

Náklady na compliance

Finanční dopad AI Act se bude lišit podle velikosti firmy. Malé firmy do 50 zaměstnanců mohou očekávat jednorázové náklady mezi 50 000 až 200 000 korunami a roční provozní náklady 20 000 až 100 000 korun, přičemž hlavní položky budou představovat právní poradenství a základní dokumentace.

Střední firmy s 50 až 250 zaměstnanci budou čelit jednorázovým nákladům 200 000 až 1 000 000 korun a ročním provozním nákladům 100 000 až 500 000 korun. Tyto náklady pokryjí audit AI systémů, školení zaměstnanců a případně pozici compliance officera.

Velké firmy s více než 250 zaměstnanci mohou očekávat jednorázové náklady v rozmezí 1 až 10 milionů korun a roční provozní náklady 500 000 až 5 milionů korun. Tyto prostředky budou investovány do komplexního auditu, certifikace, právního týmu a technických úprav systémů.

Praktické dopady pro každodenní život

Pozitivní dopady zahrnují větší důvěru v AI systémy díky regulaci, lepší kvalitu AI služeb díky požadavkům na testování, ochranu soukromí a osobních dat a snížení diskriminace v automatizovaných procesech. Na druhou stranu mohou občané očekávat pomalejší inovace v některých oblastech, vyšší ceny AI služeb kvůli compliance nákladům, omezenou dostupnost některých AI funkcí a složitější uživatelské rozhraní kvůli požadavkům na transparentnost.

Konkrétní změny se projeví v každodenním životě. Chatboti budou muset jasně označit, že jsou AI, doporučovací systémy budou muset vysvětlit své návrhy, AI filtry na sociálních sítích budou transparentnější a hlasové asistenti budou muset informovat o nahrávání a zpracování dat.

Občané se mohou na tyto změny připravit seznámením se s novými právy, naučením se klást správné otázky ohledně AI rozhodnutí, využíváním možnosti lidského přezkumu a aktivním využíváním práva na informace o AI systémech.

Zároveň s účinností od 21. února 2024 došlo ke vzniku Evropského úřadu pro umělou inteligenci (AI Office). Každý jednotlivec tam může podávat stížnosti na nedodržování pravidel AI Actu.

Dohled nad klíčovými pravidly kolem AI Actu budou mít Český telekomunikační úřad, Úřad pro technickou normalizaci, metrologii a státní zkušebnictví (ÚNMZ), Úřad pro ochranu osobních údajů, Česká národní banka, Česká agentura pro standardizaci (ČAS) a veřejný ochránce práv.

Situace okolo užívání AI byla doteď dost chaotická. Všichni si mohli s AI dělat co chtěli, někteří mohli ubližovat druhým a každému to bylo jedno. Pokud jste byl známá osoba, zdiskreditovalo vás to a nikoho nezajímalo, jestli vaše nahá fotka byla vygenerována tajným mstitelem. Vypadá to, že AI Act je tak krokem, který snad AI dá mantinely, aby se jiní nemuseli bát ji používat.

Věříme, že to nikdy nebudete potřebovat, ale kdyby náhodou, vždy se můžete podívat na tento článek, abyste zjistili, jaká jsou vaše práva ohledně souzení se proti neoprávněnému užívání AI.

Aktualizováno dne: 18. 6. 2025

Zdroje:

1. Klasifikace systému umělé inteligence dle rizik | Digitální Česko [online]. [cit. 17. 06. 2025]. Dostupné z: https://digitalnicesko.gov.cz/klasifikace-systemu-umele-inteligence-dle-rizik/

2. Akt o umělé inteligenci | Shaping Europe’s digital future [online]. [cit. 17. 06. 2025]. Dostupné z: https://digital-strategy.ec.europa.eu/cs/policies/regulatory-framework-ai

3. Umělou inteligenci v ČR už nebude mít na starost ministerstvo práce. Stát má nového zmocněnce – Lupa.cz [online]. [cit. 17. 06. 2025]. Dostupné z: https://www.lupa.cz/aktuality/umelou-inteligenci-v-cr-uz-nebude-mit-na-starost-ministerstvo-prace-stat-ma-noveho-zmocnence

4. EUIPO [online]. [cit. 18. 06. 2025]. Dostupné z: https://www.euipo.europa.eu/cs/news/navigating-the-complexities-of-generative-ai-in-intellectual-property-challenges-and-opportunities